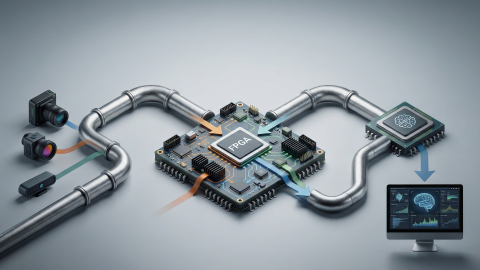

Wie Sensoren, FPGAs und IPCs intelligente Bildverarbeitung im Edge-Bereich ermöglichen

Die Embedded-Vision-Branche entwickelt sich hin zu architekturorientierten Ansätzen, die Sensorik, deterministische Datenverarbeitung und Edge-Computing für bessere Leistung und Effizienz integrieren.

Bei Embedded Vision hängen Skalierbarkeit, Latenz und Effizienz von der gesamten Pipeline ab: davon, wie effektiv Kameras und FPGAs im Frontend zusammenarbeiten, und nicht nur von der Rechenebene allein.

Embedded-Vision-Systeme sind nicht mehr auf einen einzelnen Prozessor oder Beschleuniger optimiert. Leistung und Effizienz werden dadurch bestimmt, wie Kameras, FPGA-basierte Verarbeitung und Recheneinheit über die gesamte Pipeline hinweg aufeinander abgestimmt sind. Die Kombination aus fortschrittlichen Bildsensoren und FPGAs hat sich als architektonische Grundlage für skalierbare Vision-Systeme mit geringer Latenz im Edge-Bereich etabliert.

Systemarchitekten verfolgen nun einen End-to-End-Ansatz: Der Sensor definiert die Eigenschaften des Datenstroms. Der FPGA strukturiert und konditioniert diese Daten in Echtzeit. Der IPC wandelt sie in verwertbare Informationen um. Diese architektonische Veränderung ist grundlegend, um die Anforderungen moderner eingebetteter Bildverarbeitungssysteme und Edge-KI-Anwendungen zu erfüllen.

Design-Treiber für Edge-Bildverarbeitungssysteme

In Industrie- und Embedded-Märkten arbeiten Bildverarbeitungssysteme in Umgebungen, in denen Entscheidungen lokal, zuverlässig und unter strengen Zeitvorgaben getroffen werden müssen. Deterministische Latenz ist zu einer Grundvoraussetzung für Anwendungen geworden, die von Robotik bis zu Sicherheitssystemen reichen.

Ebenso wichtig ist die Energieeffizienz: Edge-Systeme werden häufig in lüfterlosen Gehäusen oder verteilten industriellen Umgebungen betrieben, sodass es nicht praktikabel ist, auf überdimensionierte Rechenressourcen zu setzen. Die Reduzierung unnötiger Datenbewegungen und Verarbeitungsaufwände ist heute ein zentrales Ziel der Architektur.

Skalierbarkeit und Langlebigkeit treiben das Systemdesign weiter voran. Bildverarbeitungsplattformen müssen mehrere Sensormodalitäten, sich weiterentwickelnde Algorithmen und steigende Leistungsanforderungen unterstützen, ohne dass eine wiederholte Neukonzeption erforderlich ist. Diese Anforderungen begünstigen architekturgesteuerte Lösungen, die durchgängig optimiert sind, anstatt nur einzelne Komponenten zu optimieren.

Weiterlesen mit Login

Noch nicht registriert?

Registrieren Sie sich jetzt kostenfrei und Sie erhalten vollen Zugriff auf alle exklusiven Beiträge. Mit unserem Newsletter senden wir Ihnen Top-Meldungen aus der Automatisierung, Bildverarbeitung und Licht- und Lasertechnik im Industrieumfeld. Außerdem erhalten Sie regelmässig Zugriff auf unsere aktuellen E-Paper.

RegistrierenMeist gelesen

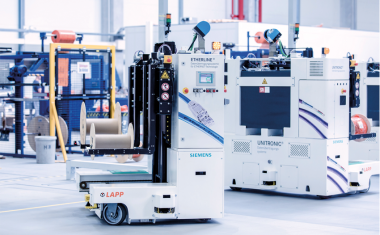

Die Zukunft der Intralogistik

Die Intralogistik befindet sich im Wandel: Der Bedarf an qualifizierten Fachkräften steigt, während gleichzeitig neue Konzepte und Technologien entstehen.

Humanoide Roboter erreichen den Mittelstand

Sinkende Kosten, schnelle Einsatzbereitschaft und steigende Flexibilität eröffnen neue Anwendungen jenseits klassischer Insellösungen.

Sind KIs Jobkiller? Nö! Aber gehypte CEOs vielleicht schon

Die tatsächlichen Produktivitätsgewinne heutiger KIs sind begrenzt. Die eigentliche Gefahr liegt weniger in der Technik als in gehypten Managern. Ein Kommentar.

Industrielle Qualitätsprüfung mit Contact-Image-Sensoren

Für die Qualitätsprüfung flacher Objekte oder Endlosmaterial sind Contact-Image-Sensoren eine Alternative zu Zeilenkameras. Rauscher erweitert sein Portfolio um Insnex-CIS-Module mit bis zu 3.600 DPI.

Mehr Kreislauf durch PCR-Spouts

Standbodenbeutel mit Ausgießer kommen in immer mehr Anwendungen zum Einsatz. Setzen Hersteller auf Monomaterial-Konzepte, lassen sich Verpackungen besser recyceln und in den Kreislauf zurückführen.