Chatbots für tote, gefährdete und ausgestorbene Sprachen

Möglichkeiten und Grenzen generativer KI für die Weiterbildung

Oliver Bendel

1. Einleitung

Sprache dient Lebewesen zur Kommunikation. Bei Menschen ist sie Kulturwerkzeug und Kulturgut, Zugang zur Welt und Filter der Welt, und Heimat im besten Sinne, Wohlfühl- und Rückzugsort. Sie ist wie Moral in einem Individuum angelegt und braucht zu ihrer Entfaltung und Vervollkommnung die Gruppe bzw. die Gemeinschaft (Bendel 2023b). Die Vielfalt menschlicher Sprachen ist ein Phänomen, das ebenso eint wie trennt: Man versteht sich oder man versteht sich nicht. Wenn man den anderen nicht versteht, aber dazulernt, versteht man ihn irgendwann und drückt sich selbst aus, vielleicht mit Einschränkungen, aber immerhin so, dass man Teil der Sprachgemeinschaft wird und Einfluss auf den Sprachgebrauch gewinnt. Der Verlust einer Sprache ist nicht nur ein linguistisches, sondern ein individuelles, kulturelles und anthropologisches Ereignis.

Laut UNESCO sind über 40 Prozent der weltweit existierenden Sprachen gefährdet, viele davon akut (UNESCO 2010). Was Eltern und Großeltern noch vertraut ist, wird den Kindern und Enkeln unbekannt. In einzelnen Fällen – etwa bei Latein – ist die Sprache zwar „tot“, also ohne Muttersprachler, bleibt jedoch über Jahrhunderte hinweg ein Träger geistesgeschichtlicher Bildung und wissenschaftlicher Beschäftigung. Andere Sprachen, wie das Ägyptische oder Akkadische, sind ausgestorben und lassen sich nur noch fragmentarisch rekonstruieren. Diese Entwicklungen sind eine Herausforderung für ganze Kulturen und für einzelne Bildungseinrichtungen. Und im Falle gefährdeter Sprachen für jedes Individuum.

Gleichzeitig entstehen im Bereich der künstlichen Intelligenz (KI) neue Technologien, die dazu beitragen können, Sprachverlust zu dokumentieren, zu reflektieren und ihm womöglich entgegenzuwirken. Besonders hervorzuheben sind Chatbots, die durch Fortschritte bei der generativen KI zu semantisch und syntaktisch potenten und flexiblen Systemen geworden sind (Bendel 2017a, b, 2019a, 2024a). Dahinter stecken heute meist Large Language Models (LLMs) – also große Sprachmodelle – sowie multimodale Varianten (MLLMs), die neben Text auch Bild, Ton oder andere Medienformate verarbeiten. Sie alle verfügen über ein breites „Sprachverständnis“ und sind in der Lage, Sprachstrukturen nachzubilden, Grammatik und Semantik wiederzugeben und Benutzern als künstliche Gesprächspartner zu dienen, in schriftlicher oder gesprochener Sprache (Shi et al. 2020).

Chatbots auf Basis generativer KI könnten sich damit als geeignete Werkzeuge erweisen, um tote, gefährdete und ausgestorbene Sprachen in die Aus- und Weiterbildung zu integrieren. Dies gilt für das formelle oder formale Lernen (etwa an klassischen Bildungsinstitutionen) ebenso wie für das informelle Lernen (etwa im Selbststudium), für Kinder und Jugendliche ebenso wie für Erwachsene. Der Zugang über die natürlichsprachlichen Fähigkeiten der Dialogsysteme, ergänzt durch didaktische und technische Mittel, kann den Erwerb oder das Einüben solcher Sprachen – einschließlich Dialekte und Idiome – erleichtern oder überhaupt erst ermöglichen. Chatbots sind einfach benutzbar und rund um die Uhr verfügbar, und sie können dialogisch, ludisch (also in spielerischer Weise) und explorativ eingesetzt werden.

Der Autor dieses Beitrags hat von September 2022 bis Januar 2025 an der Hochschule für Wirtschaft FHNW mehrere Projekte in diesem Zusammenhang durchgeführt (Bendel und N’diaye 2023; Bendel und Jabou 2024; Lluis Araya 2024). Dabei entstanden Chatbots wie @ve (für Latein), @llegra (für das rätoromanische Idiom Vallader), kAIxo (für Baskisch) sowie experimentelle Anwendungen wie Cleop@tr@ (für Ägyptisch) und H@mmur@pi (für Akkadisch). Zudem wurden GPTs für Maori (Maori Girl) und Irisch (Irish Girl) aufgesetzt. Diese Prototypen zeigen exemplarisch, wie generative KI selbst verdrängte und vernachlässigte Sprachen modellieren, als Gesprächspartner auftreten und das Lernen unterstützen kann – mit allen Chancen und Risiken, die damit verbunden sind. Bereits ab 2012 entwickelte der Autor mit seinen Studenten auch Chatbots als moralische Maschinen, aus der Disziplin der Maschinenethik heraus (Bendel 2019a, b). Sie und die Systeme für gefährdete Sprachen lassen sich Konzepten wie „AI for Good“ oder „AI for Well-being“ zuordnen (Rellstab und Bendel 2025).

Im Zentrum des vorliegenden Beitrags steht die Frage, wie Chatbots auf der Basis generativer KI zur Erhaltung und Förderung toter, gefährdeter und ausgestorbener Sprachen in der Weiterbildung (sowie in der Ausbildung) beitragen können. Nach einer Einführung in die technischen und konzeptionellen Grundlagen (Abschnitt 2) werden mehrere Projekte vorgestellt und in technischer, ethischer und didaktischer Hinsicht diskutiert (Abschnitt 3). Diese Dimensionen werden in Abschnitt 4 wiederaufgenommen und ins Allgemeine und Übergreifende geführt. Am Ende (Abschnitt 5) werden mögliche und notwendige Schritte skizziert, die über den rein technologischen Diskurs hinausweisen. Zudem wird ein Ausblick auf künftige Möglichkeiten gegeben, die mit neuen Versionen von großen Sprachmodellen zusammenhängen.

2. Grundlagen

2.1 Tote, gefährdete und ausgestorbene Sprachen

Natürliche Sprachen sind Kommunikationsformen lebendiger Wesen. Sie sind selbst im übertragenen Sinne lebendige Systeme, die entstehen, sich entwickeln, sich wandeln und vergehen. In der sprachwissenschaftlichen Klassifikation, die sich auf die Sprache von Menschen richtet, unterscheidet man zwischen lebenden, gefährdeten, toten und ausgestorbenen Sprachen (UNESCO 2010; Eberhard et al. 2023). Eine lebende Sprache wie das Englische, das Französische und das Deutsche wird aktiv gesprochen und in der Regel in Alltag, Bildung, Kultur und Verwaltung verwendet, in mündlicher wie in schriftlicher Form.

Gefährdete Sprachen sind hingegen in ihrem Fortbestand bedroht, sei es durch eine geringe bzw. abnehmende Zahl von Sprechern, durch mangelnde Weitergabe an nachfolgende Generationen oder durch Dominanz stärker verbreiteter Sprachen im sozialen und medialen Raum. Die UNESCO differenziert innerhalb gefährdeter und ausgestorbener Sprachen nach fünf Stufen: „vulnerable“, „definitely endangered“, „severely endangered“, „critically endangered“ und „extinct“ (UNESCO 2010; Bendel und Jabou 2024). Ein verwandter Begriff ist derjenige der bedrohten Sprache.

Eine tote Sprache wie Latein wird nicht mehr als Muttersprache gesprochen, bleibt jedoch in Bildung, Wissenschaft oder Religion präsent (Bendel und N’diaye 2023). Vergleichbare Beispiele sind Sanskrit und Altgriechisch. Sanskrit ist allerdings ein Sonderfall, weil es in Indien einige Tausend Menschen gibt, die es im Alltag aktiv verwenden oder sich zumindest darum bemühen. Eine ausgestorbene Sprache wie Ägyptisch (mit Hieroglyphen) oder Akkadisch (mit Keilschrift) hingegen ist nicht mehr Teil des Sprachgebrauchs, häufig nurmehr in Schriftzeugnissen erhalten und auf umfangreiche Rekonstruktion und Interpretation angewiesen.

Die Gründe für die Entwicklungen und Umwälzungen der Kommunikation der Gegenwart sind vielfältig. Globalisierung, Depopulation, Migration, technologische Standardisierung und mediale Monopolisierung bzw. Omnipräsenz führen zu einem Rückgang sprachlicher Diversität. Bekannte Beispiele sind Maori, Irisch, Baskisch und Sardisch (Sardinisch). Betroffen sind sowohl Sprachen im engeren Sinne als auch Dialekte und Idiome. Der Verlust einer Sprache bewirkt den Verlust kulturellen Wissens, gesellschaftlicher Erzählungen und persönlicher Ausdrucksformen und damit eines Teils der menschlichen Vielfalt.

2.2 Chatbots und Sprachassistenten und ihre Ausprägungen

Ein Chatbot – engl. „chatbot“, aus „chat“ („Schwatz“) und „bot“ als Kurzform von „robot“ („Roboter“) – ist ein dialogorientiertes Computersystem, das auf Texteingaben reagiert und sprachlich kohärente Antworten generiert. Er gehört zu den Conversational Agents, wie auch Sprachassistenten (Bendel 2023a), im Englischen „voice assistants“ genannt. Diese – etwa Siri, Alexa oder Google Assistant – verarbeiten Spracheingabe und erzeugen Sprachausgabe, sind also für gesprochene Sprache geschaffen. Klassische Chatbots arbeiten hingegen oft rein textbasiert, können aber ebenfalls mit Sprachfunktionen erweitert werden, etwa mit einer Sprachausgabe.

Man unterscheidet zwischen regelbasierten Systemen, bei denen auf fest definierte Inputs fest definierte Outputs erfolgen, und Systemen, die durch maschinelles Lernen (engl. „machine learning“) entstanden sind bzw. verbessert werden. Generative Chatbots auf der Grundlage von LLMs – also Vertreter der zweiten Kategorie – sind in der Lage, auf beliebige Eingaben zu reagieren, bestimmte Zusammenhänge herzustellen und komplexe Dialoge (teils mit Rückgriff auf frühere Sequenzen) zu führen. Beide Kategorien kann man künstlicher Intelligenz zuordnen – es geht in ihnen darum, die Ergebnisse menschlicher Intelligenz über ein Computersystem nachzubilden, hier eben Elemente des Dialogs (Bendel 2017b).

Im Bildungskontext sind Chatbots u.a. dort sinnvoll einsetzbar, wo sie als Gesprächspartner dienen, um Sprachverständnis, Grammatik, Vokabular oder idiomatische Wendungen einzustudieren bzw. zu trainieren. Dabei können sie einfach zugängliche Übungsräume schaffen, etwa für Lernende ohne Zugang zu Muttersprachlern, für selbstgesteuertes Lernen oder für spielerische Vertiefung. In manchen Zusammenhängen genügen Texteingabe und -ausgabe, in anderen ist Sprachausgabe wesentlich, um die Sprache (auch ihre Aussprache) kennenzulernen und zu erlernen – und dann erfolgreich in einer Sprachgemeinschaft anzuwenden.

Insgesamt haben Chatbots und Sprachassistenten eine lange Tradition in der Bildung. Der Autor dieses Beitrags hat um die Jahrtausendwende zu diesem Thema seine Doktorarbeit geschrieben. In ihr ging es um sogenannte pädagogische Agenten. Meist waren dies regelbasierte Dialogsysteme mit statischen oder dynamischen Avataren (Bendel 2003). In manchen Fällen waren Hardwarekomponenten vorhanden, etwa Systeme zur Gesichtserkennung oder Werkzeuge zur Objektmanipulation. Einige wenige Systeme waren echte Agenten (auch KI-Agenten genannt) mit Zielorientierung und Autonomie. Vorläufer von pädagogischen Agenten waren wiederum Intelligente Tutorielle Systeme und Virtual Learning Companions der ersten Generation (Hauske und Bendel 2024).

2.3 Potenziale für den Sprachenerhalt und die Weiterbildung

Der Einsatz generativer Chatbots für tote, gefährdete oder ausgestorbene Sprachen liegt auf der Hand. Sie können als künstliche Gesprächspartner fungieren, wenn natürliche schwer oder gar nicht zu finden sind, sie können grammatikalisches und lexikalisches Wissen vermitteln, auch solches, das in der Sprachgemeinschaft nicht bekannt ist, und Inhalte zu Geschichte und Kultur zur Verfügung stellen (Bendel 2017a). Besonders relevant ist dies für die Weiterbildung, in der es häufig an strukturiertem Sprachunterricht mangelt oder spezifische Lernziele verfolgt werden, etwa für Lehrkräfte und Kulturvermittler.

Durch einfache Zugänglichkeit, intuitive Benutzbarkeit, hohe Interaktivität und individuelle Skalierbarkeit erschließen sich Chatbots mit generativer KI einem breiten Anwenderkreis und passen sich an unterschiedliche Benutzerbedürfnisse an (Bendel 2024a) – gerade bei gefährdeten Sprachen kann es ganz verschiedene Ziele und Zwecke geben. Sie können sowohl für einführende Lernphasen als auch für vertiefende Übungen genutzt werden (Hauske und Bendel 2024). Sie sind nicht an Ort oder Zeit gebunden und ermöglichen dialogisches, ludisches, exploratives Lernen. Dies ist gerade im Zusammenhang mit gefährdeten Sprachen wichtig.

Sicherlich sind die Systeme kein Ersatz für menschliche Sprachlehrer (die bei gefährdeten Sprachen freilich immer schwieriger zu finden sind) und Muttersprachler (die bei gefährdeten Sprachen freilich immer mehr verschwinden) oder für philologische Präzision. Ihre Rolle liegt im Angebot, in der Ergänzung, in der Simulation. Sie eröffnen neue Lernwege, müssen jedoch kritisch begleitet und reflektiert eingesetzt werden, gerade in ethischer und didaktischer Hinsicht. Es ist auch die Frage, ob sie den Niedergang gefährdeter Sprachen aufhalten können – oder ob sie nur deren temporäre Begleiter sind, die eines Tages unausweichlich mit ihnen zugrunde gehen.

3. Projekte zu Chatbots an der Hochschule für Wirtschaft FHNW

In diesem Abschnitt werden Projekte zu Chatbots für tote, gefährdete und ausgestorbene Sprachen vorgestellt, die der Autor dieses Beitrags zwischen September 2022 und Januar 2025 initiiert, beauftragt bzw. durchgeführt hat. Mehrheitlich wurden Bachelorarbeiten in der Wirtschaftsinformatik als Ausgangspunkt genutzt. Es handelte sich entsprechend um Low-Budget-Projekte, finanziert vom Autor selbst. Es geht nicht darum, sämtliche Projekte in diesem Bereich aufzuführen und auszuwerten, wobei gesagt werden kann, dass es um das Jahr 2022 noch kaum Bemühungen gab, LLMs in diesem Sinne zu nutzen.

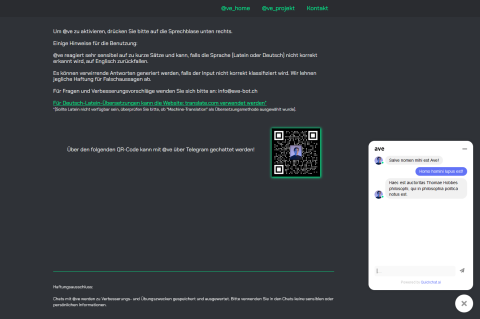

3.1 @ve: Ein Chatbot für Latein

Das erste Projekt im Kontext toter und gefährdeter Sprachen an der Hochschule für Wirtschaft FHNW wurde im September 2022 vom Autor dieses Beitrags initiiert und beauftragt (ausgeschrieben und finanziert). Sein Student Karim N’diaye entwickelte @ve, einen Chatbot für Latein, also eine tote Sprache (Bendel und N’diaye 2023). Die Basis war GPT-3, ergänzt durch eine manuell kuratierte Wissensbasis. Ziel war es, ein textbasiertes System zu schaffen, das einfache Dialoge auf Latein ermöglicht, Vokabular und Grammatik korrekt anwendet und erklärt sowie sich in historischen und kulturellen Zusammenhängen zurechtfindet.

Der Chatbot ist nicht nur ein technisches Artefakt, sondern ein didaktisches Werkzeug. Er richtet sich an Schüler, Studenten, Weiterbildungsteilnehmer und alle, die Latein außerhalb formaler Bildungssettings üben oder vertiefen wollen. Als Einstieg für den Dialog diente der populäre Ausruf „Ave“ (dt. „Sei gegrüßt“), zugleich Namensgeber des Chatbots. Der Projektmitarbeiter sammelte und strukturierte lateinische Texte, übersetzte Inhalte und entwickelte ein promptbasiertes Dialogmodell. @ve wurde in eine Website und einen Instant Messenger (Telegram) integriert (Bendel und N’diaye 2023). Zum Projekt steht ein Video zur Verfügung.

In einem Testdurchlauf mit einem Lateinexperten zeigten sich Stärken und Schwächen (Bendel und N’diaye 2023). Der Chatbot konnte grammatikalisch korrekte Sätze erzeugen, einfache Konversationen führen und Vokabelfragen beantworten. Gleichzeitig offenbarte er typische Schwächen damaliger (teils auch heutiger) generativer Systeme, nämlich semantische Unschärfen, gelegentliche Fehler bei Kasus oder Konjugationen und inkonsistente Reaktionen. Für einen alleinstehenden Einsatz in und neben der Schule war @ve zu diesem Zeitpunkt kaum geeignet, wohl aber als begleitendes Lernmedium.

Aus ethischer Sicht stellt sich u.a. die Frage nach kultureller Authentizität: Kann ein großes Sprachmodell eine tote Sprache in ihrer historischen und kulturellen Tiefe abbilden? Die Antwort lautet: Nur in gewissem Maße. Chatbots wie @ve sind keine digitalen Reinkarnationen des klassischen Lateins, sondern simulationsbasierte Angebote, deren Stärken in Motivation und Wiederholung liegen, nicht in philologischer Präzision. Von daher können sie durchaus eine irreführende Vorstellung von dieser Sprache hervorrufen.

Didaktisch kann @ve dennoch ein wertvolles Instrument sein, insbesondere im Unterricht mit Begleitung durch Lehrer, für selbstgesteuertes Lernen bei Fortgeschrittenen und für den spielerischen Einstieg. Auch außerhalb der Schule, etwa in der Weiterbildung für Theologen, Philosophen oder Mediziner, die auf das Latinum angewiesen sind, bietet @ve einen niederschwelligen Zugang und eine anregende Vermittlung. Wichtig ist, dass es ein Korrektiv gibt, wenn Fehler auftauchen, und diese durch das System nicht regelrecht antrainiert werden.

Zu ergänzen ist, dass das Projekt ursprünglich anders angelegt war. Es sollte ein Chatbot für das Rätoromanische entstehen, der erste seiner Art überhaupt. Im Rahmen von GPT-3 scheiterte das Projektteam aber daran. Der Initiator gab nach einigen Diskussionen die neue Richtung vor. Es war vermutlich der erste Chatbot auf der Basis generativer KI, der auf Latein spezialisiert war. Das Interesse an ihm war dennoch gering. Den für Kooperationen und Publikationen angefragten Lateinern erschien das Technische suspekt, den angefragten Technikern das Lateinische – zumindest deutet der Autor dieses Beitrags die Reaktionen so.

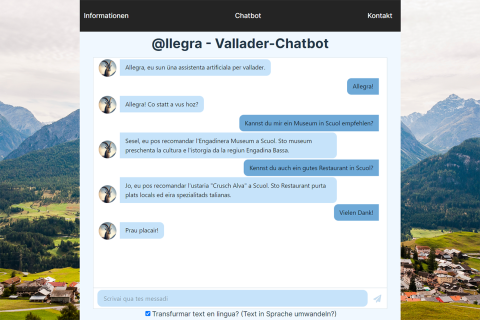

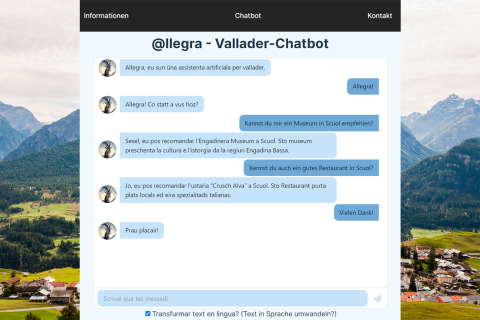

3.2 @llegra: Ein Chatbot für Vallader

2023 entstand an der Hochschule für Wirtschaft FHNW der Chatbot @llegra für das rätoromanische Idiom Vallader (Bendel und Jabou 2024). Der Ausruf „allegra“ bedeutet im Deutschen wörtlich „Sei fröhlich“ oder „Freu dich“ und wird als Begrüßung verwendet, ähnlich wie „Hallo“ oder „Grüß dich“. Rätoromanisch ist eine offizielle Landessprache der Schweiz, wird jedoch nur noch von wenigen Zehntausend Menschen gesprochen (das Idiom Vallader vorwiegend im Unterengadin). Das Projekt wurde erneut vom Autor des Beitrags initiiert und beauftragt. Sein Student Dalil Jabou entwickelte @llegra auf Basis von GPT-4 – dem LLM, das endlich in diesem Kontext den Durchbruch brachte.

Der Chatbot unterstützt Textverarbeitung sowie Sprachausgabe und ist mit einer manuell kuratierten Wissensbasis zu Sprache und Kultur angereichert (Bendel und Jabou 2024). Als Avatar dient ein Steinbock, das Symbol von Graubünden und Teil dessen Wappens. Der Initiator sprach von einem Steinbockmädchen, um einen Bezug zum weiblich klingenden Namen herzustellen. @llegra wurde in eine Website integriert, die zwischenzeitlich vom Netz genommen wurde. Zur Dokumentation wurde ein Video produziert.

Ziel des Projekts war es, ein Werkzeug zur Verfügung zu stellen, das Einheimische und Muttersprachler sowie Lernende außerhalb des Sprachraums ansprechen kann, womöglich auch Touristen, die im Unterengadin unterwegs sind. Neben der sprachlichen Kompetenz kann @llegra umfangreiches Wissen über Geografie, Geschichte und Eigenheiten der Region vorweisen, bis hin zu Informationen zu lokalen Museen. Das macht den Steinbock nicht nur zu einem Lernassistenten, sondern auch zu einem „Kulturagenten“. So kannte er sich bestens in Scuol mit seinen Einrichtungen aus, um nur ein Beispiel zu nennen.

Die technische Umsetzung profitierte von bereits vorhandenen Entwicklungen im Bereich Text-to-Speech. Es konnte eine auf Vallader gerichtete Engine einer Zürcher Firma eingebaut werden (Bendel und Jabou 2024). Tests mit Muttersprachlern zeigten positive Reaktionen – zugleich wurden kleinere Ungenauigkeiten bei der Grammatik festgestellt. Vor allem aber kippte @llegra immer wieder in ein anderes Idiom, etwa Sursilvan, oder in Rumantsch Grischun, die ungeliebte, künstliche Standardsprache der Medien und Behörden. Der Chatbot eignete sich insgesamt gut zur mündlichen Übung und zum Verstehen gesprochener Sprache, weniger zur Korrektur komplexer Satzstrukturen.

Aus ethischer Sicht ergibt sich die Frage, wie sich die kulturelle Souveränität kleiner Sprachgemeinschaften wahren lässt, wenn ihre Sprache in die Hände generativer KI gelegt wird. Die Entwickler suchten – soweit möglich – den Dialog mit der Community und setzten auf Transparenz sowie auf Diskretion. @llegra wurde nicht als autoritativer Sprecher des Vallader programmiert, sondern als lernbegleitendes System mit explizitem Beta-Charakter. Dennoch werden letztlich einem gefährdeten, fragilen Idiom die impliziten oder expliziten Vorstellungen eines Konzerns übergestülpt.

Didaktisch überzeugt @llegra insbesondere mit Blick auf die Erwachsenenbildung. Wer Rätoromanisch lernen will, ohne formalen Kurs, findet im Chatbot einen Gesprächspartner, der nicht bewertet, sondern instruiert und motiviert. Auch für Muttersprachler kann @llegra zur Sprachpflege beitragen, gerade in einer Umgebung, in der der mediale Raum vom Deutschen und der öffentliche Raum vom Schweizerdeutschen dominiert wird – ganz abgesehen von Rumantsch Grischun. Dabei ist insbesondere an Kinder zu denken, die den Chatbot attraktiv finden und mit ihm bevorzugt lernen wollen.

Hinzuzufügen ist, dass bei Gesprächen mit Einrichtungen, Medien und Muttersprachlern immer wieder zum Ausdruck kam, dass man die Beschäftigung mit dem Rätoromanischen im Projekt als Einmischung oder Zumutung wahrnimmt. Der Initiator stammt aus Deutschland, der Student hat einen arabischen Namen und Hintergrund – für einige ein Grund, die Zuständigkeit und Geeignetheit anzuzweifeln. Das lässt sich einerseits nicht ganz von der Hand weisen, denn man war trotz aller Liebe zum Idiom nicht wirklich kundig darin und auf Übersetzungstools wie Textshuttle (später Supertext, https://www.supertext.com/de-CH) angewiesen. Andererseits musste jemand einen Anfang wagen, zumal auch hier unter den Sprachfreunden nicht viele Technikfreunde waren.

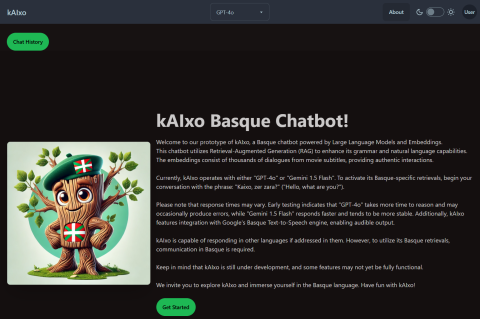

3.3 kAIxo: Ein Chatbot für Baskisch

kAIxo ist ein Chatbot für die baskische Sprache, entwickelt von Nicolas Lluis Araya im Jahre 2024 an der Hochschule für Wirtschaft FHNW (Lluis Araya 2025), mit Projektabschluss im Januar 2025. Der Autor dieses Beitrags hatte wiederum das Projekt initiiert und beauftragt. Dieses gestaltete sich technisch wie inhaltlich anspruchsvoll, denn das Baskische gehört zu den ältesten Sprachen Europas, ist sprachlich isoliert und wird trotz offizieller Anerkennung in weiten Teilen Frankreichs bzw. Spaniens kaum noch gesprochen. Das baskische „kaixo“ bedeutet im Deutschen „hallo“. Als Avatar wurde ein Baum gewählt, der die Eiche von Gernika darstellen soll, ein Symbol für den Widerstand und das Überleben des Baskenlands.

Technisch wurde der Chatbot von dem Studenten mit dem Framework LangChain realisiert, kombiniert mit einer RAG-Architektur (Lluis Araya 2025), wobei das Akronym für Retrieval-Augmented Generation steht. Als Datenquelle dienten baskische Filmuntertitel und -dialoge, die in einer Vektordatenbank hinterlegt wurden. Auf der Website erfolgte die Auswahl zwischen GPT-4o und Gemini 1.5 Flash. Die Text-to-Speech-Funktion ermöglichte zusätzlich ein gezieltes Hörverständnistraining. Die Engine von Google war brauchbar, aber nicht so überzeugend wie die für das Rätoromanische im Projekt zu @llegra. Zwei Testphasen mit Freiwilligen belegten hohe Lernmotivation und gute Verständlichkeit (Lluis Araya 2025). Zum Projekt kann ein Video über https://youtu.be/lrCjypaQrnM aufgerufen werden.

Erwähnenswert ist noch, dass es sich bei kAIxo mit dem LangChain-Framework um einen KI-Agenten handelt. Dieser verfügt über eine gewisse Entscheidungsfreiheit und kann je nach Anwendungsfall selbstständig auf unterschiedliche Tools und Ressourcen zurückgreifen, z.B. bei unterschiedlichen Sprachkenntnissen (Anfänger, Fortgeschrittene, Profis) oder bei unterschiedlichen Anliegen und Zusammenhängen auf geeignetes Material. Das Ganze lässt sich zu einem Multiagentensystem erweitern. Damit bestehen insgesamt Anknüpfungspunkte an Agentenprojekte der 1990er- und 2000er-Jahre.

Aus ethischer Sicht war das Projekt bewusst sensibel und integrativ angelegt: Die Entwicklung erfolgte in enger Rückkopplung mit der Onlinecommunity, insbesondere über Reddit (Lluis Araya 2025). Rückmeldungen zu Aussprache, Grammatik und kulturellem Kontext wurden iterativ eingearbeitet. Dennoch bleibt die Frage nach der kulturellen Verantwortung im Raum: Kann ein KI-System die Vielfalt einer lebendigen Sprache abbilden, ohne sie zu vereinfachen? Und bedeutet die Macht eines Konzerns hier nicht die Macht über die Sprache einer Minderheit?

Didaktisch zeigte sich kAIxo als flexibles Werkzeug für selbstgesteuerte Lernprozesse und damit auch für bestimmte Formen der Weiterbildung. Vor allem für Lernende außerhalb des Baskenlands erwies er sich potenziell als niederschwellige Unterstützung, gerade weil er kaum technische und sprachliche Voraussetzungen verlangt und rund um die Uhr verfügbar ist. Die Integration der Audioausgabe wurde von Testpersonen besonders geschätzt. Die Website wurde – wenn man die automatisierten Zugriffe abzieht – von vielleicht Tausend Unbekannten von August 2024 bis August 2025 besucht. Eine Analyse der Chatverläufe fand nicht statt.

Zu ergänzen ist, dass trotz bestehender Kontakte mit der Universität des Baskenlandes (baskisch „Euskal Herriko Unibertsitatea“, spanisch „Universidad del País Vasco“) keine Zusammenarbeit mit Wissenschaftlern oder Experten etabliert werden konnte. Auch Autoren baskischer Lehr- und Grammatikbücher lehnten eine Zusammenarbeit im Rahmen von RAG ab. Das Projektteam hatte den Eindruck, dass man die Forschung als Einmischung in die Belange der Sprachgemeinschaft empfand. Allerdings könnte genauso die Angst vor künstlicher Intelligenz eine Rolle gespielt haben – und der Argwohn gegenüber dem Umstand, dass eigene Texte von kommerziellen großen Sprachmodellen benutzt werden sollten.

3.4 Chatbots für ausgestorbene Sprachen: Cleop@tr@ und H@mmur@pi

Ein experimentelles Kapitel stellen Chatbots für ausgestorbene Sprachen dar. Cleop@tr@ für Ägyptisch und H@mmur@pi für Akkadisch wurden im Jahre 2024 vom Autor dieses Beitrags in Form von GPTs („custom versions of ChatGPT“, wie OpenAI sie nennt) entwickelt. Auch wenn keine Muttersprachler und Sprecher mehr existieren, kann generative KI genutzt werden, um rekonstruierte Sprachstrukturen zu simulieren, Schriftzeichen zu analysieren und zu interpretieren sowie dialogische Lernprozesse anzustoßen. Voraussetzung ist stets, dass Trainingsmaterial zur Verfügung steht, was bei ägyptischen Hieroglyphen und babylonischer Keilschrift durchaus der Fall ist.

Mit Cleop@tr@ – Kleopatra VII. Thea Philopator war der letzte Pharao der makedonisch-griechischen Dynastie der Ptolemäer und u.a. bekannt durch ihre Beziehung mit Julius Cäsar, den sie 48 v.u.Z. zum ersten Mal traf – wurden ab Mai 2024 zunächst Dialoge geführt. Es ging darum, dass der Benutzer einfache Sätze mit Hieroglyphen bilden konnte. Ähnliche Versuche wurden mit H@mmur@pi unternommen. Hammurapi I. war von 1792 bis 1750 v.u.Z. der sechste König der ersten Dynastie von Babylonien, berühmt geworden durch den Codex Hammurapi, die älteste vollständig erhaltene Rechtssammlung. In Ägypten wurde Cleop@tr@ Ende 2024 durch den Autor dieses Beitrags zuerst im Karnak-Tempel, dann im Tal der Könige getestet. Dabei lieferte der Chatbot bei Inschriften auf Säulen und Mauern stimmige Erklärungen, produzierte aber auch grobe Fehler.

Insgesamt haben diese Chatbots ihren Wert, nicht als Experten und Autoritäten, sondern als niederschwellige Einstiegshilfen, für verspielte Gesprächsführungen, als Instrumente historisch-sprachlicher Neugier. Sie eignen sich für Museen, Ausstellungen oder Bildungseinrichtungen, die Kultur digital vermitteln wollen. Sie bieten Spannung und Unterhaltung für Touristen, die auf Bildungsreisen sind und im besten Falle noch sachkundige Bücher eingepackt haben, um die Chatbots im Zweifel korrigieren zu können. Deren experimenteller Charakter ist bewusst gewollt und fordert zur Ergänzung und zum Widerspruch heraus.

Die technische Umsetzung der GPTs war einfach und schnell möglich (Hauske und Bendel 2024). Es wurden Prompt Engineering und RAG verwendet. Der Entwickler führte Tests mit unterschiedlichen Dokumenten durch, ohne dabei einen großen Umfang oder eine bemerkenswerte Tiefe anzustreben. Es ging eher darum, das Prinzip und die grundsätzliche Tauglichkeit – bei allen Schwächen und Fehlern – zu zeigen. Ein technischer Fehler Anfang 2024, der zu diesem Zeitpunkt viele GPTs betraf – bei ihnen wurden die hochgeladenen Dokumente entfernt, ohne dass dies von OpenAI direkt kommuniziert wurde –, führte zu vorübergehenden Einschränkungen. Dies zeigt erneut die Problematik der Abhängigkeit vom Anbieter.

Ethisch relevant ist hier wiederum die Frage nach sprachlicher Authentizität und kultureller Aneignung. Führt die Nutzung von generativer KI zu Vereinfachungen und Verzerrungen? Dies kann durchaus der Fall sein, wenn keine fachliche Kontrolle vorhanden oder die Datenlage ungenügend ist. Deshalb sind solche Systeme keine Ersatzakteure für Archäologen oder Philologen, sondern vielmehr explorative Werkzeuge, die Neugier wecken und Wissen zugänglich machen.

Didaktisch ergibt sich ein spannender Effekt: Der Dialog mit einem Chatbot wie Cleop@tr@ oder H@mmur@pi könnte als initialer Impuls dienen, sich vertieft mit Geschichte, Sprache und Kultur zu beschäftigen, über digitale Medien und künstliche Ansprechpartner hinaus. Hier dürfte sowohl die Ausbildung als auch die Weiterbildung ein möglicher Rahmen sein, im besten Falle angeleitet durch Experten zum Thema.

4. Technische, ethische und didaktische Diskussion des Einsatzes von Chatbots für bestimmte Sprachen

In diesem Abschnitt erfolgt eine technische, ethische und didaktische Diskussion der Nutzung von Chatbots für tote, gefährdete und ausgestorbene Sprachen. Spezifische Überlegungen fanden bereits im letzten Abschnitt statt – nun geht es um eine allgemeinere Sicht.

4.1 Technische Aspekte

Generative Chatbots bieten durch ihre Architektur auf Basis von LLMs eine Kombination aus Zugänglichkeit und Ausdrucksstärke. Sie sind niederschwellig in der Anwendung – über grafische Benutzeroberflächen, Websites oder Instant Messengers – und gleichzeitig mächtig in ihrer Interaktions- und Kommunikationsfähigkeit. Die Textverarbeitung erfolgt in natürlicher Sprache, die Systeme reagieren dialogisch, können neue Inhalte erzeugen und – u.a. über RAG – strukturierte wie unstrukturierte Daten einbinden. Manchmal ist Sprachausgabe vorhanden.

Die Niederschwelligkeit liegt auch in der Herstellbarkeit: Viele dieser Systeme, wie GPTs, kann man ohne Programmierkenntnisse aufbauen oder anpassen (Hauske und Bendel 2024). Plattformen wie der GPT-Builder von OpenAI bieten Möglichkeiten, in einigen Minuten oder wenigen Stunden funktionale Chatbots zu erstellen, unterstützt durch Retrieval-Augmented Generation und Text-to-Speech. Allerdings ist man dadurch abhängig vom Anbieter, und in der Vergangenheit gab es bereits – wie erwähnt – Datenverluste, um die man sich selbst kümmern musste. Auch Versionswechsel können zu Problemen führen.

Die Mächtigkeit der Chatbots auf der Basis generativer KI zeigt sich in ihrer Fähigkeit zur Kontextverarbeitung, zur semantischen Generalisierung und zur Simulation komplexer Sprachakte (Bendel 2024a), was in Gesprächen essenziell ist. Lernende können sich mit ihnen unterhalten, Fehler machen, Korrekturen erfahren, kulturelle Kontexte abfragen, und all das in einem Dialog, der sich in seiner Struktur dem menschlichen Gespräch annähert. Immer mehr wurde den Systemen beigebracht, nicht nur reaktiv, sondern auch aktiv und proaktiv zu sein, etwa durch Nachfragen und Aufforderungen.

Gleichwohl sind technische Grenzen offensichtlich. Die Modelle arbeiten statistisch und erzeugen Sprache, ohne sie zu verstehen. Falsche oder irreführende Aussagen aufgrund von Manipulationen sind ebenso möglich wie Halluzinationen (Bendel 2024a). Dies ist insbesondere bei ausgestorbenen oder nur fragmentarisch dokumentierten Sprachen kritisch zu sehen, da hier oft keine Kontrollinstanz zur Verfügung steht. Dem kann man wiederum mit RAG entgegenwirken – die Welt des Lernens wird mit der des Wissens kombiniert.

Bei den meisten LLMs wurde der Fokus auf große Sprachen gesetzt. GPT-4o und GPT-5.2 sind im Englischen besonders bewandert. Dort, im aktuellen Sprachgebrauch, wurde eine Stärkung eigentlich seltener Begriffe festgestellt (Yakura et al. 2025). Auch im Deutschen finden sich bemerkenswerte Fehler und Abweichungen, wie eigene und andere Beobachtungen und Tests gezeigt haben. So verwendet das LLM etwa Spiegelstriche und Aufzählungen in unüblicher Weise. Zudem wird Gendersprache bevorzugt, in Abweichung von der Standardsprache, was mit den Prinzipien von OpenAI zusammenhängt. Bei Rätoromanisch und Baskisch ist immerhin Schriftsprachlichkeit vorhanden, die genutzt werden kann, nicht zuletzt von Open-Source-Modellen, bei denen dann Finetuning angewandt werden kann.

4.2 Ethische Perspektiven

Aus ethischer Sicht lassen sich sowohl Chancen als auch Risiken erkennen. Chatbots für gefährdete Sprachen können zur Demokratisierung von Bildung beitragen, zur Sichtbarkeit marginalisierter Kulturen und zur individuellen Sprachaneignung. Sie ermöglichen einen spielerischen Zugang, schaffen neue Räume für Sprachpflege, fördern historisches und kulturelles Bewusstsein und stärken das Prinzip der Selbstwirksamkeit. Sie können selbstorganisiertes Lernen unterstützen und institutionalisiertes Lernen ergänzen.

Zugleich ergeben sich Herausforderungen im Bereich der Informations- und Medienethik. Die Systeme basieren in der Regel auf proprietären Modellen großer Konzerne, etwa OpenAI, Google, Meta oder xAI. Damit verbunden ist eine strukturelle Abhängigkeit: Datenverarbeitung, Hosting und Modellanpassung liegen nicht in öffentlicher, sondern in privatwirtschaftlicher Hand. Dies wirft Fragen der Souveränität und Transparenz auf, gerade im Kontext kleiner Sprachgemeinschaften, die sich technologisch kaum selbst vertreten können.

Ein weiteres ethisches Spannungsfeld betrifft die Frage der erwähnten Manipulation. Generative Systeme formen Inhalte, filtern, paraphrasieren. Sie können Perspektiven einbringen oder unterschlagen, historisieren oder entkontextualisieren. Im schlimmsten Falle werden Bedeutungen trivialisiert oder kulturelle Elemente unangemessen dargestellt, etwa durch stereotype Rollenbilder oder oberflächliche Exotisierung. Auch Sexualität meiden viele LLMs und MLLMs, oft aus der allgemein bekannten amerikanischen Prüderie bzw. Bigotterie heraus oder aus Angst vor rechtlichen Konsequenzen (Bendel 2024b).

Ein Problem wurde schon bei den technischen Grundlagen genannt. GPT-4o und GPT-5 verwenden eine Sondersprache, eben die Gendersprache, und behaupten im Diskurs, es handle sich nicht nur um eine breit verwendete, sondern auch gerechte Sprache, was von Studien widerlegt und der klassischen Sprachwissenschaft bezweifelt wird (Meineke 2023). Vor allem ist es gefährlich, wenn Konzerne aus moralischen oder anderen Gründen eigene Standards setzen und damit Sprachverwendung beeinflussen, insbesondere wenn es um amerikanische Konzerne und nichtenglische Sprachgemeinschaften geht. Ähnlich wie in der DDR ist dies der Versuch einer Sprachveränderung von oben.

Wenn eine solche Manipulation beim Deutschen stattfindet, kann dies bei jeder anderen Sprache der Fall sein. Gerade bei gefährdeten Sprachen kann es schwierig sein, den Grad und die Art der Abweichungen festzustellen, und ebenso schwierig, dagegen vorzugehen. Auch dazu eine Erkenntnis beim Deutschen: Selbst wenn ChatGPT mit GPT-4o in den Einstellungen des Plus-Kunden angewiesen wird, keine Gendersprache zu verwenden, unterläuft es diesen Wunsch regelmäßig – die Prinzipien, die auf mehreren Ebenen umgesetzt werden, sind offenbar stärker als die Benutzerprompts. Damit wird man nicht nur als Kunde nicht ernst genommen, sondern auch unmündig gehalten. Das Phänomen konnte vom Autor in vergleichbarer Weise bei GPT-5.2 beobachtet werden.

Weiterhin ist der Datenschutz zu beachten. Dialogsysteme sammeln und speichern Eingaben, behalten Angaben zum Kontext, werten Muster aus. Zwar bieten kommerzielle Unternehmen und andere Organisationen zunehmend Optionen zur Datensparsamkeit, bis hin zu Systemen, die lokal laufen, also offline, doch bleibt der Schutz persönlicher Daten fragil, insbesondere bei Systemen, die von Kindern, Jugendlichen oder kulturpolitisch sensiblen Gruppen genutzt werden. Zudem kommt es auf die Anbieter und Entwickler an, die die LLMs für eigene Varianten nutzen, etwa als GPTs.

Ein Ausweg liegt im Aufbau offener, nichtkommerzieller Alternativen – etwa durch öffentlich geförderte große Sprachmodelle, deren Trainingsdaten transparent dokumentiert sind, oder durch das Finetuning von verbreiteten Open-Source-Modellen. In diesem Geiste ist in der Schweiz 2025 ein LLM namens Apertus entstanden, dessen Code vollständig zur Verfügung gestellt wurde. Mit Chatbots auf diesen Grundlagen können sich Bildungsinstitutionen unabhängiger machen, kulturelle Kontrolle zurückgewinnen und ethische Standards einfordern. Eine solche Strategie wird in einem „Nachfolgeprojekt“ zu @llegra namens IdiomVoice verfolgt, das sich dem Idiom Sursilvan widmet und von mehreren Schweizer Hochschulen getragen wird.

In Bezug auf die Maschinenethik schließlich stellt sich die Frage, wie die Systeme gestaltet sein sollten, um moralisch vertretbar zu agieren (Bendel 2019b, c). Der Ansatz des Moral Prompt Engineering und des dazu passenden RAG – etwa in Form der Implementierung von Netiquetten und Leitlinien (Rellstab und Bendel 2025), die das Verhalten des Chatbots steuern – kann hier ein praktikabler Weg sein. Damit wird ermöglicht, Chatbots nicht nur funktional, sondern auch moralisch anschlussfähig zu machen, was im Bildungsbereich besonders wichtig scheint.

4.3 Didaktische Potenziale

Die Weiterbildung, verstanden sowohl als formelle als auch als informelle Bildung jenseits der Ausbildung (Bendel und Hauske 2004), ist ein idealer Ort für den Einsatz generativer Chatbots zur Sprachförderung. Hier begegnen sich Neugier, Praxiserfahrung und lebenslanges Lernen – ein Feld, das dialogische Systeme besonders gut bedienen können. Unter Umständen ist man aber auch, vor allem beim informellen Lernen, alleingelassen.

Chatbots können in der Weiterbildung auf vielfältige Weise eingesetzt werden, als individuelle Sprachtrainer, als Vermittler kulturellen Wissens oder als interaktive Tutoren, Mentoren und Coaches (Hauske und Bendel 2024). Sie eignen sich zur Wiederholung, zur Festigung und zur Anwendung, insbesondere bei Lernzielen, die auf verbale Ausdrucksfähigkeit, idiomatisches Sprachgefühl oder landeskundliches Wissen gerichtet sind.

Die Integration kann innerhalb institutioneller Settings erfolgen – etwa an Volkshochschulen, an Hochschulen oder in kulturellen Zentren – oder im selbstorganisierten Lernen. Denkbar sind hybride Formate, in denen Menschen und Chatbots kooperieren: Der Chatbot dient der Übung, die Lehrkraft der Reflexion und Korrektur. Oder der Chatbot bietet Input, und die Gruppe diskutiert dessen Gehalt. Dabei entsteht ein didaktischer Mehrwert, der über klassische Lernszenarien hinausweist.

Besonders vielversprechend ist der Einsatz bei gefährdeten Sprachen, die oft nur noch in Fragmenten überliefert sind oder in der Diaspora gesprochen werden. Hier können Chatbots zur Brücke zwischen Generationen werden, zwischen Sprachgemeinschaften und digitalen Lernräumen. Auch ausgestorbene Sprachen sind ein Anwendungsfall. Dabei mag die Weiterbildung in der schöngeistigen und bildungsbürgerlichen Beschäftigung mit der Antike bestehen, was ihren Wert keinesfalls mindert.

Gleichzeitig ist Vorsicht geboten, denn Systeme wie GPT-5.2, Claude, Gemini oder Grok sind – wie angedeutet – weder neutral oder objektiv noch unfehlbar. Ihre Verwendung im gegebenen Kontext erfordert Medienkompetenz, kritisches Denken sowie Verständnis für algorithmische Prozesse – Fähigkeiten, die ihrerseits Gegenstand von Weiterbildung sein sollten. Es gilt, ob im Unterricht in den Institutionen oder im Selbststudium, die Macht der Konzerne und ihren Hang zur Manipulation zu verstehen und auszugleichen.

Der Bildungsraum wird somit doppelt erweitert, nämlich durch neue Inhalte und durch neue Formen. Chatbots sind keine Ersatzlehrkräfte und keine Ersatzmuttersprachler, sondern ergänzende Werkzeuge – mit erheblichem didaktischem Potenzial, aber auch mit einem hohen Bedarf an pädagogischer Einbettung, ethischer Reflexion und institutioneller Verantwortung.

5 Zusammenfassung und Ausblick

Tote, gefährdete und ausgestorbene Sprachen stehen exemplarisch für die Fragilität von Kommunikationsformen, Kulturwerkzeugen und Kulturgütern. Mit dem Verschwinden einer Sprache gehen nicht nur Wörter und Strukturen verloren, sondern auch Weltsichten, Erzähltraditionen, soziale Praktiken und individuelle Präferenzen. Und Heimat, ein wichtiger Begriff, den man nicht der politischen Rechten überlassen darf. Der Erhalt gefährdeter Sprachen ist mehr als ein akademisches, linguistisches Projekt – er ist ein ethisches und ein kulturpolitisches Anliegen.

Im vorliegenden Beitrag wurde gezeigt, wie Chatbots auf der Basis generativer KI zur Förderung solcher Sprachen in der Aus- und Weiterbildung eingesetzt werden können. Die beschriebenen Projekte – von @ve für Latein über @llegra für Vallader bis hin zu kAIxo für Baskisch und Cleop@tr@ für Ägyptisch bzw. H@mmur@pi für Akkadisch – belegen, dass technologische Lösungen geeignet sind, Zugänge zu schaffen, Aufmerksamkeit zu erzeugen und Lernprozesse zu unterstützen. Sie leisten einen Beitrag zur kulturellen Resilienz und ermöglichen neue Formen der Auseinandersetzung mit Sprache, unabhängig von Ort, Zeit und institutionellem Rahmen.

Technisch zeichnen sich diese Systeme durch ihre Dialogfähigkeit, ihre Kontextsensibilität und ihren Kenntnisstand (bei systemisch bedingter Ahnungslosigkeit) aus. Didaktisch bieten sie Übungsräume, die individuell skalierbar, ludisch und explorativ sowie motivierend sind. Ethisch eröffnen sich Chancen zur Sichtbarmachung marginalisierter Sprachräume – zugleich müssen Fragen nach Urheberrecht, Datenhoheit, kultureller Aneignung und algorithmischer Verzerrung sowie Manipulation kritisch reflektiert werden.

Der Beitrag hat auch deutlich gemacht, dass Chatbots keine Ersatzinstanzen sind. Sie sind Werkzeuge – nicht Lehrer, nicht Wissenschaftler, nicht Sprachautoritäten. Ihre Stärken liegen im Angebot, nicht im Urteil. Sie liegen in der Dialogfähigkeit, nicht in der Letztgültigkeit. In der Weiterbildung können sie deshalb vor allem als Ergänzung dienen, als „Zweitstimme“, als Gesprächsanlass und als Anlass zur Reflexion.

Für die Zukunft ergeben sich mehrere Anliegen, die sich aus den Praxisbeispielen mit ihren spezifischen Überlegungen und Beobachtungen und der technischen, sozialen und didaktischen Diskussion ableiten lassen:

- Erstens gilt es, offene, transparente und gemeinwohlorientierte große Sprachmodelle zu fördern, etwa durch öffentlich finanzierte KI-Infrastrukturen oder Kooperationen mit kulturellen Institutionen. Nur so lässt sich die Abhängigkeit von internationalen Konzernen und kommerziellen Plattformen mindern.

- Zweitens sollten ethische Leitlinien – begründete und nützliche Regelwerke – für kulturell sensible Entwicklungen und Anwendungen generativer KI entwickelt und in der Unternehmens- und Bildungspraxis verankert werden, mit besonderem Augenmerk auf Urheberrecht, Datenschutz, Partizipation und Repräsentation.

- Drittens empfiehlt sich eine systematische Integration von Medien-, IT- und KI-Kompetenz in die Aus- und Weiterbildung, um nicht nur mit Chatbots und Sprachassistenten zu lernen, sondern auch über sie, über ihre Funktionsweise, ihre Begrenzungen, ihre individuellen und sozialen Effekte. Hilfreich sind überdies zusätzliche Plattformen mit Informationen und Ressourcen.

- Und viertens wäre eine stärkere Zusammenarbeit mit Sprachgemeinschaften, Linguisten, Didaktikern und Kulturträgern wünschenswert, um Chatbots als kooperative Projekte zu begreifen – nicht als technische Replikation, sondern als gemeinsame kulturelle Gestaltung. Dazu muss man aber, wie angedeutet, erst unhaltbare (oder berechtigte) Vorurteile erkennen und abbauen. Im Falle der ausgestorbenen Sprachen sind zudem Experten für die Antike gefragt, von Latinisten bis hin zu Ägyptologen.

In einer Zeit, in der sich Bildung, Sprache und Technologie überlagern, entstehen neue Räume des Lernens, in der Ausbildung, aber auch und gerade in der Weiterbildung. Chatbots können darin hilfreich und zielführend sein, wenn sie mit Bedacht entwickelt, kritisch begleitet und reflektiert genutzt werden. Sie sind kein Allheilmittel gegen Sprachverlust, aber ein möglicher Weg, vergessene Sätze wieder erscheinen zu lassen und verstummte Stimmen wieder hörbar zu machen. Und sei es nur für ein paar Jahre oder Jahrzehnte.

Mit der Weiterentwicklung großer Sprachmodelle – etwa zu Systemen der Größenordnung von GPT-5.x – eröffnen sich für gefährdete Sprachen weitere Möglichkeiten, die über die im Beitrag beschriebenen Ansätze hinausgehen. Fortschritte bei Multimodalität, Kontextualisierung und Adaptivität erlauben es, kleine Sprachkorpora effektiver zu nutzen, Dialekte präziser zu modellieren und dialogische Lernumgebungen stärker zu personalisieren. Moderne LLMs bzw. MLLMs können nicht nur Texte erzeugen, sondern auch gesprochene Sprache erkennen und synthetisieren, historische Quellen analysieren, Varianten vergleichen und kollaborative Lernräume für verstreute Sprachgemeinschaften schaffen.

Dadurch könnten Chatbots (und Sprachassistenten) zu dauerhaften Infrastrukturkomponenten werden, als Werkzeuge für Dokumentation, für die Erstellung von Materialien, für die Wiederbelebung von Sprachpraktiken im Alltag oder für den Aufbau von Sprachgemeinschaften im Netz. Gleichzeitig verstärkt sich damit die Notwendigkeit, solche Systeme gemeinsam mit Linguisten, Philosophen, Kulturträgern und den betroffenen Gemeinschaften zu entwickeln, um technologische Möglichkeiten mit kultureller Authentizität und sprachlicher Souveränität zu verbinden.

Literatur

Bendel, Oliver. Pädagogische Agenten im Corporate E-Learning. Dissertation, Difo, St. Gallen, 2003.

Bendel, Oliver. „Chatbot“. In Gabler Wirtschaftslexikon. Springer Gabler, 2017a. https://wirtschaftslexikon.gabler.de/definition/chatbot-54248.

Bendel, Oliver. „Künstliche Intelligenz“. In Gabler Wirtschaftslexikon. Springer Gabler, 2017b. https://wirtschaftslexikon.gabler.de/definition/kuenstliche-intelligenz-54119.

Bendel, Oliver. „Von Cor@ bis Mitsuku: Chatbots in der Kundenkommunikation und im Unterhaltungsbereich“. In Handbuch Digitale Wirtschaft, herausgegeben von Tobias Kollmann, 1–17. Springer Gabler, 2019a. https://doi.org/10.1007/978-3-658-17345-6_86-1.

Bendel, Oliver. „Chatbots as Moral and Immoral Machines: Implementing Artefacts in Machine Ethics“. In Proceedings of the Workshop ‘Conversational Agents: Constructing Action Plans from a Wave of Research and Development’, Glasgow, UK, Mai 2019b.

Bendel, Oliver. 400 Keywords Informationsethik. Grundwissen aus Computer-, Netz- und Neue-Medien-Ethik sowie Maschinenethik. 2. Aufl. Springer Gabler, 2019c. https://doi.org/10.1007/978-3-658-26664-6.

Bendel, Oliver. „Conversational Agent“. In Gabler Wirtschaftslexikon. Springer Gabler, 2023a. https://wirtschaftslexikon.gabler.de/definition/conversational-agent-125248.

Bendel, Oliver. „Sprache“. In Gabler Wirtschaftslexikon. Springer Gabler, 2023b. https://wirtschaftslexikon.gabler.de/definition/sprache-124739.

Bendel, Oliver. 300 Keywords Generative KI: Ökonomische, technische und ethische Grundlagen. Springer Gabler, 2024a.

Bendel, Oliver. „How Can Generative AI Enhance the Well-Being of Blind?“. In Proceedings of the AAAI 2024 Spring Symposium Series, Symposium ‘Impact of GenAI on Social and Individual Well-being’, 340–47. Burlingame, CA: The AAAI Press, 2024b. https://ojs.aaai.org/index.php/AAAI-SS/article/view/31232/33392.

Bendel, Oliver und Stefanie Hauske. E-Learning: Das Wörterbuch. Sauerländer Verlage, 2004.

Bendel, Oliver und Dalil Jabou. „@llegra: A Chatbot for Vallader“. International Journal of Information Technology, 2024. https://doi.org/10.1007/s41870-024-01779-0.

Bendel, Oliver und Karim N’diaye. „@ve: A Chatbot for Latin“. ArXiv, 2023. https://arxiv.org/abs/2311.14741.

Eberhard, David M., Gary F. Simons und Charles D. Fennig, eds. Ethnologue: Languages of the World. 26th ed. SIL International, 2023. https://www.ethnologue.com.

Hauske, Stefanie und Oliver Bendel. „How Can GenAI Foster Well-Being in Self-Regulated Learning?“. In Proceedings of the AAAI 2024 Spring Symposium Series, Symposium ‘Impact of GenAI on Social and Individual Well-being’, 354–61. Burlingame, CA: The AAAI Press, 2024. https://ojs.aaai.org/index.php/AAAI-SS/article/view/31234/33394.

Lluis Araya, Nicolas. kAIxo: Ein Chatbot für Baskisch. Erhaltung einer gefährdeten Sprache. Bachelorarbeit, Hochschule für Wirtschaft FHNW, Olten, 2025.

Meineke, Eckhard. Studien zum genderneutralen Maskulinum. Universitätsverlag Winter, Heidelberg 2023.

Rellstab, Myriam und Oliver Bendel. „Miss Tammy as a Use Case for Moral Prompt Engineering“. In Proceedings of the AAAI 2025 Spring Symposium ‘Human-Compatible AI for Well-Being: Harnessing Potential of GenAI for AI-Powered Science’, März–April 2025. Burlingame, CA: The AAAI Press. https://ojs.aaai.org/index.php/AAAI-SS/issue/view/654.

Shi, Nuobei, Qin Zeng und Raymond Lee. „The design and implementation of Language Learning Chatbot with XAI using Ontology and Transfer Learning“. ArXiv, 2020. https://arxiv.org/abs/2009.13984.

UNESCO. Atlas of the World’s Languages in Danger. Edited by Christopher Moseley and Nicolas, Alexandre. Paris: UNESCO, 2010. http://www.unesco.org/culture/languages-atlas/.

Yakura, Hiromu, Ezequiel Lopez-Lopez, Levin Brinkmann, Ignacio Serna, Prateek Gupta, Ivan Soraperra und Iyad Rahwan. „Empirical evidence of Large Language Model’s influence on human spoken Communication“. V3. ArXiv, 2025. https://arxiv.org/abs/2409.01754.