3D-Daten von dynamischen Bewegungen

Time-of-Flight-Kamera mit On-Chip-Tiefenerfassung für die Logistik

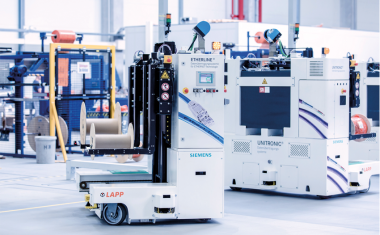

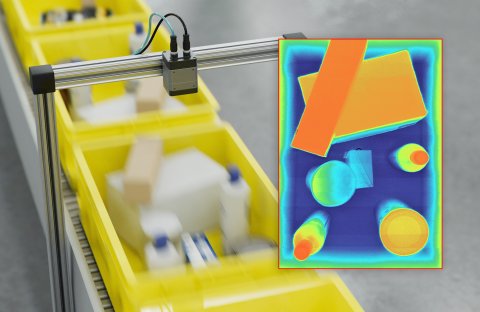

Für die Logistik werden 3D-Informationen immer wichtiger. Position, Höhe, Volumen und Form sollen automatisiert erfasst werden, ohne Prozesse zu verlangsamen – so die Forderung. Wie lassen sich 3D-Daten erzeugen, ohne sich mit der Komplexität klassischer High-End-Technik auseinanderzusetzen? Die Antwort liefert eine Time-of-Flight-Kamera.

Mit 2D-Kameras lassen sich bereits viele Aufgaben in der Logistik lösen – allerdings mit nachgeschalteter Bildverarbeitung. Wo Tiefen- und Formdaten Prozessvorteile bringen, entsteht durch 3D-Daten ein Mehrwert: So ermöglichen präzise rekonstruierte Kanten genauere Volumenberechnungen; oder Roboter nutzen stabilere Positionsdaten, was Fehlgriffe verringert und in manchen Fällen den Einsatz einfacherer Endeffektoren erlaubt. In einem Förderprozess bedeutet die schnellere Bereitstellung der Tiefeninformationen zudem, dass Teile nicht mehr gezielt im Sichtfeld der Kamera positioniert werden müssen. Dies senkt den Hardwareaufwand und reduziert Kosten. Doch 3D-Erfassung galt lange als teure Technologie, die sich nur bei sehr präzisen Messaufgaben lohnte.

3D-Kameras mit Time-of-Flight-Technologie (TOF) bieten für viele Logistikanwendungen die benötigte räumliche Information ohne den Preis und die Komplexität klassischer High-End-3D-Technik. Allerdings stoßen bei dynamischen Förderprozessen viele TOF-Kameras an ihre Grenzen. Die marktüblichen VGA-Sensoren liefern nur eine begrenzte Datendichte und benötigen zur Tiefenberechnung mehrere zeitlich aufeinanderfolgende Belichtungen und Ausleseschritte. Dies verlängert die Geamtaufnahmezeit, in der sich schnelle Objekte so stark bewegen, dass unscharfe oder unpräzise Tiefeninformationen entstehen.

Spezieller Sensor mit On-Chip-Tiefenerfassung

Das ändert sich jetzt mit den neuen iTOF-Sensoren. Die Tiefenberechnung erfolgt direkt im Sensor, gleichzeitig steigt die Auflösung auf 1,2 MP. Diese technische Entwicklung macht 3D-Erfassung in Bereichen attraktiv, die bisher aus Kosten- oder Integrationsgründen ausschließlich 2D genutzt haben.

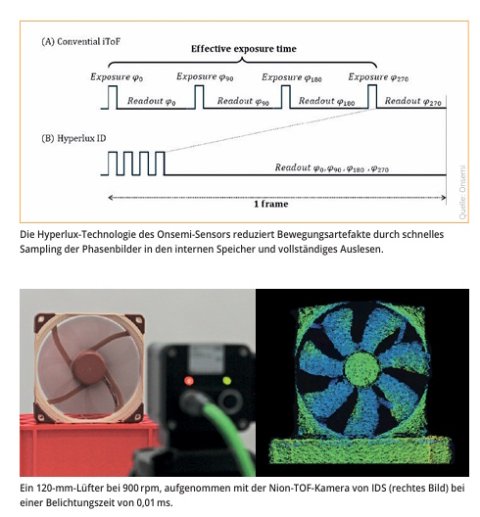

Zur Berechnung eines einzigen Tiefenwerts sind bei indirekter Time-of-Flight-Technologie vier aufeinander abgestimmte Belichtungen mit unterschiedlichen Phasenlagen (typischerweise 0°, 90°, 180° und 270°) notwendig. Aus diesen vier Signalen wird dann die Phasenverschiebung und damit die Entfernung berechnet.

Aufgrund seiner speziellen Pixelarchitektur und der integrierten On-Chip-Verarbeitung erfasst der AF0130-Sensor der Onsemi-Hyperlux-Serie alle vier Phasenbilder in schneller Folge und speichert sie vollständig im Speicher des Chips, ohne zwischenzeitliches Auslesen. Dadurch wird die Zeit zwischen den Belichtungen verkürzt und die Bewegungsunschärfe reduziert. Das macht die Kamera robuster gegenüber Bewegungen, ermöglicht höhere Bildraten und entlastet das Host-System. Gerade in dynamischen Anwendungen wie Robotik, Logistik oder Pick-and-Place ist dies von Vorteil.

Mit der Nion nutzt IDS den aktuellen iTOF-Sensor AF0130 von Onsemi in einer kompakten 3D-Kamera mit Schutzart IP67, die sich über IDS Peak und GigE Vision direkt in bestehende Systeme integrieren lässt. Damit steht eine Einstiegslösung bereit, die hochauflösende 3D‑Daten mit integrierter Tiefenverarbeitung und robuster Unterdrückung von Umgebungslicht nutzbar macht, auch in Anwendungen, die bislang klar im 2D‑Bereich lagen.

Hohe Bandgeschwindigkeiten möglich

Um die Bewegungsstabilität der Tiefenmessung zu prüfen, wurde in internen Tests ein Lüfter mit 120 mm Durchmesser bei 900 U/min aufgenommen. Bei einer Belichtungszeit von 0,01 ms entstanden vollständig scharfe 3D-Daten ohne sichtbare Bewegungsartefakte. Die äußere Kante des Lüfters bewegt sich dabei mit circa 5,7 m/s. Dieser Wert liegt in einem Bereich, wie er auch auf schnellen Förderstrecken üblich ist. Für Betreiber bedeutet das: Die 3D-Tiefendaten bleiben selbst bei hohen Geschwindigkeiten stabil, ohne dass das Band verlangsamt oder angehalten werden muss.

„Damit müssen Abläufe nicht gestoppt werden.“

Interview mit Patrick Schick, Product Manager 3D Vision & Imaging Software bei IDS Imaging Development Systems

IDS bringt eine 3D-Kamera auf den Markt, die auf Time-of-Flight basiert, aber deren Schwächen besser ausgleichen will. Während bisherige Systeme mit begrenzter Reichweite, Lichtempfindlichkeit und Unschärfen kämpfen, verspricht die Nion robuste Tiefendaten, hohe Auflösung und zuverlässige Ergebnisse selbst bei schnellen Bewegungen. Welche Vorteile die Technologie bietet und weshalb die Kamera für neue Einsatzfelder interessant wird, erklärt Patrick Schick, Product Manager 3D Vision & Imaging Software.

inspect: Warum setzt IDS mit der Nion auf die Time-of-Flight-Technik?

Patrick Schick: Die Nion ergänzt die 3D-Oberliga der Ensenso-Stereovision-Kameras und erweitert das Portfolio um eine kosteneffiziente Lösung für Anwender, die zuverlässige 3D-Daten ohne hohe Präzisionsanforderungen benötigen. Die iTOF-Technologie des Hyperlux-Sensors von Onsemi liefert dazu stabile Tiefeninformationen und gleicht typische TOF-Schwächen wie begrenzte Reichweite, Umgebungslichtempfindlichkeit und Genauigkeit durch moderne Sensortechnik aus. Wir haben die Nion als Allround-ToF-Kamera konzipiert. Sie deckt viele Anwendungen ab und benötigt dafür wenig Integrationsaufwand. Damit eröffnet sie einen einfachen und wirtschaftlichen Zugang zu 3D-Technik und ist nicht auf spezielle Nischen beschränkt.

inspect: Welche Vorteile hat die Kamera für Anwender?

Schick: Die Nion bietet einen ganz praktischen Vorteil: Sie liefert viel mehr verwertbare 3D-Informationen. Durch die Quad-VGA-Auflösung entsteht eine hohe Datendichte. Damit lassen sich Stör- und Rauschpunkte deutlich besser herausfiltern. Das macht die Tiefenmessung stabil und zuverlässig.

Wir setzen außerdem auf 940-Nanometer-Licht. In diesem Bereich arbeitet der Sensor besonders effizient und bleibt gleichzeitig unempfindlich gegenüber Sonnenlicht, Kunstlicht oder stark wechselnden Lichtverhältnissen. So funktioniert die Kamera drinnen wie draußen und liefert überall detailreiche 3D-Bilder.

Ein weiterer großer Vorteil ist die integrierte Tiefenverarbeitung des Hyperlux-Sensors. Die Kamera nimmt die Phasenbilder sehr schnell hintereinander auf und liest sie in einem Schritt aus. Dadurch entstehen auch bei bewegten Objekten kaum Unschärfen. Die Ergebnisse bleiben klar, selbst wenn sich etwas schnell durch das Bild bewegt.

inspect: Wie hoch ist die Auflösung, wie hoch die FPS?

Schick: Neben der hohen XY-Auflösung des 1,2-Megapixel-Sensors erreicht die Nion trotz der kleineren Pixelfläche eine Tiefengenauigkeit von etwa 5 Millimetern und eine Wiederholpräzision von rund 1,4 Millimetern. Frequenzen bis 200 MHz ermöglichen eine besonders feine Auflösung in der Tiefe, weil die Kamera kleinste Phasenunterschiede genau erkennt. Das ist ideal für den Nahbereich. Für größere Entfernungen lässt sich die Frequenz reduzieren, um den Arbeitsbereich zu erweitern und trotzdem stabile Tiefenwerte zu erhalten.

Bei voller Sensorauflösung (1.280 x 960 Pixel) schafft die Nion bis zu 30 Tiefenbilder pro Sekunde, bei VGA-Auflösung deutlich mehr. Wichtig ist aber: Der Anwender bestimmt selbst das Verhältnis aus Reichweite, Präzision und Bildrate.

inspect: Für welche Anwendungen eignet sich die Nion besonders?

Schick: In der Logistik misst, verfolgt und identifiziert Nion Objekte und Pakete unabhängig von Größe oder Distanz. Auch bei bewegten Prozessen wie Fördertechnik oder rotierenden Teilen bleibt die Tiefenerfassung stabil und nahezu frei von Bewegungsunschärfe. Das sorgt dafür, dass Abläufe nicht gestoppt werden müssen.

Der niedrige Einstiegspreis erweitert das Einsatzfeld auf Anwendungen, die bislang im 2D‑Bereich lagen – etwa Füllstandskontrollen oder Präsenzprüfungen, die bisher mit 2D‑Kameras und klassischer Bildverarbeitung gelöst wurden. Dass eine kosteneffiziente 3D-Kamera solche Prüfungen heute genauso zuverlässig und oft sogar einfacher löst, zeigt, wie vielseitig Nion einsetzbar ist.

inspect: Wann ist die 3D-Kamera erhältlich?

Schick: Der offizielle Marktstart der Nion erfolgte zum zweiten Quartal 2026. Wir haben uns bei diesem ersten 3D-Produkt bewusst Zeit genommen. Mit frühen Prototypen haben wir intensiv Feldtests durchgeführt und viel Feedback gesammelt. Dieses Feedback haben wir genutzt, um die Kamera so auszulegen, dass sie möglichst viele Anforderungen aus der Praxis erfüllt und Anwendern einen echten Nutzen bietet.