Embedded Vision – die Zukunft der Bildverarbeitung?

Seit mehr als einem Jahrzehnt geistert der Begriff Embedded Vision durch die Bildverarbeitung. Viele Anwender haben ihn bereits gehört, können sich aber nichts Konkretes darunter vorstellen. Was sich hinter Embedded Vision verbirgt, wo die Herausforderungen liegen und welche Hürden es zu überwinden gilt, war Thema einer Expertenrunde.

„Vor 14 Jahren haben wir den ersten Embedded-Vision-Computer auf der Vision gezeigt - heute gibt es uns noch immer", stellt Carsten Strampe, Geschäftsführer Imago Technologies, fest, und unterstreicht so, dass man mit Embedded-Vision-Systemen erfolgreich am Markt bestehen kann. Strampe ist davon überzeugt, dass die Erfolgsgeschichte Embedded Vision jetzt erst richtig beginnt. Auch Mikael Bodin, Business Unit Manager Vision bei Sick, und Kamalina Srikant, Product Marketing Manager NI Vision Hardware & Software bei National Instruments, betonen, dass sie mit den Embedded-Vision-Produkten ihrer Unternehmen sehr erfolgreich am Markt agieren und die Umsätze zukünftig weiter wachsen werden.

Die zukünftigen Potentiale erklärt Jeff Bier, Gründer der Embedded Vision Alliance, anhand eines einfachen Beispiels: Heutige Luxusautos sind mit kamerabasierten Sicherheitssystemen ausgestattet, die letztendlich nichts anderes sind als Embedded-Vision-Systeme. In den kommenden Jahren werden diese Kamerasysteme auch in preisgünstigere Modelle vordringen, sodass in 10 bis 15 Jahren praktisch alle Neuwagen solch ein System an Bord haben werden. Aktuell laufen jährlich rund 65 Millionen Autos vom Band.

Uneinigkeit bei Definitionsfrage

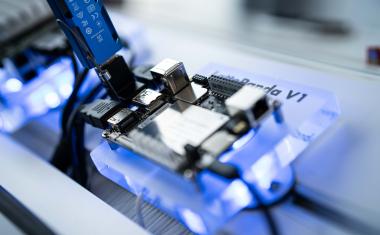

Bei der Frage, was sich hinter Embedded Vision verbirgt, gehen die Meinungen der Experten auseinander. Doch auch wenn für den einen bereits eine Microsoft-Kinect-Spielkonsole oder ein Smart Phone ein Embedded-Vision-System darstellt, hat man sich auf eine Definition geeinigt. Embedded Vision umfasst die gesamte Bildverarbeitung (Hard- und Software), die innerhalb eines Gehäuses platziert ist. Kurz gesagt: ein Stand-alone-System mit integriertem Rechner und Betriebssystem. Gerade im Maschinenbau sieht Carsten Strampe den Trend zu kompakten Systemen, die immer mehr Funktionen in einem Gehäuse vereinen. „Viele Leute denken bei Embedded Vision nur an kleine Systeme. Wir haben aber Kunden, die mit mehreren Highspeed-Kameras und einem Embedded Multicomputer auch große Applikationen lösen." Für Mikael Bodin ist von Vorteil, dass Vision-Sensoren durch Embedded-Systeme zukünftig noch leistungsfähiger werden, z.B. im Bereich der Roboter-Positionierung. Dies ermöglicht den Zugang zu völlig neuen Märkten, die bisher aufgrund der hohen Anschaffungskosten für PC-basierte Lösungen nicht in Frage kamen.

Auch für autonome oder Service-Roboter ergeben sich völlig neue Möglichkeiten. Sie können beispielsweise an Stellen eingesetzt werden, die für Menschen schwer zugänglich sind und an denen der Roboter autark entscheiden muss, was vor Ort zu tun ist, stellt Kamalina Srikant weitere Einsatzgebiete vor. Sie unterstreicht, dass sich durch Embedded Vision zahlreiche Vorteile für den Anwender ergeben, da einzelne Komponenten nun ganz individuell für die jeweilige Applikation zusammengebaut werden können. Unbestritten ist, dass Embedded-Systeme wesentlich besser geeignet sind, um Real-Time-Aufgabenstellungen zu lösen als klassische BV-Systeme. „Genau aus diesem Grund benutzen einige Anwender kein PC-System", ergänzt Carsten Strampe.

Um die Potentiale von Embedded Vision zu erschließen, wurde 2011 die Embedded Vision Alliance (www.embedded-vision.com) gegründet. Gründer Jeff Bier definiert die Ziele der Organisation dahingehend, dass mittels Embedded Vision auch gänzlich neue, nicht-industrielle Märkte, wie z.B. Medizin oder Weiterbildung, angegangen werden sollen. Welche Möglichkeiten sich dabei ergeben, beschreibt er anhand einer aktuellen Anwendung: ein Stift, an dessen Spitze eine IR-Kamera sitzt. Schreibt man damit auf spezielles Papier, ist es möglich, alle handgeschriebenen Notizen direkt auf einen Computer zu übertragen. Dieses Produkt kostet weniger als 100 US-$ und basiert letztendlich auf einem Vision-System. Falls es gelingen würde, andere Vision-Systeme derart günstig anzubieten, würden sich völlig neue Möglichkeiten für die Qualitätskontrolle von Produkten, die bisher preislich nicht zu realisieren waren, ergeben.

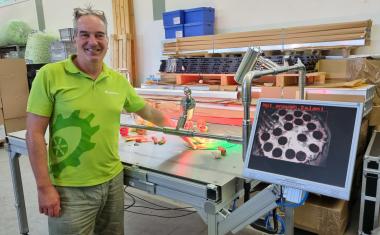

Herausforderung: Vision-Systeme für BV-Laien

Die Grenzen für Embedded Vision ergeben sich zum einen durch technische Begrenzungen, die z.B. aus der Hitzeentwicklung der Komponenten resultieren, die immer mehr Leistung auf immer kleinerem Raum bringen müssen. Allerdings ist sich Mikael Bodin sicher, dass die Entwicklung der Mikroelektronik hier zeitnah einen Fortschritt ermöglichen wird. Vor allem die rasanten Entwicklungen im Bereich der GPUs und FPGAs erlauben beeindruckende Prozessperformance-Steigerungen, betont Kamalina Srikant. Für Carsten Strampe bestehen die Grenzen dagegen vorwiegend in den Köpfen der Entwickler, die sich mit der Anwendung von Embedded-Systemen schwertun, obwohl die sich in normalem C++ programmieren lassen. Für Jeff Bier ist problematisch, dass Vision heute immer noch ein Thema von Experten für Experten ist und die Anzahl der Vision-Experten stark begrenzt ist. Die Frage ist: Wie schafft man es, dass Nicht-Vision-Experten, wie z.B. Maschinenbauer oder Mediziner, zukünftig in der Lage sind, Embedded-Vision-Systeme zu nutzen bzw. zu entwickeln? Die Kunst besteht darin, zukünftige Vision-Systeme so einfach zu gestalten, dass auch Nicht-Vision-Experten sie benutzen und bedienen können. So sollte auch ein Verfahrenstechniker zukünftig in der Lage sein, ein Vision-System für seine Anwendungen entwickeln zu können, ohne vorher fünf Jahre Bildverarbeitung studieren zu müssen.

Die Frage bleibt, ob Embedded-Kameras nur durch große OEM-Anwender programmiert werden können oder ob sich zukünftig auch kleine Ingenieurbüros damit beschäftigten dürfen. Ziel muss es sein, dass jeder Ingenieur eine solche Kamera für seine Vision-Applikation bedienen kann. Allerdings betont Jeff Bier, dass man heute noch sehr weit von diesem Punkt entfernt sei. Ohne langjährige Erfahrung in der Bildverarbeitung, Linux und C++-Kenntnissen dürfte es dem Anwender schwer fallen, sinnvolle Applikationen selbst zu entwickeln. Gerade unter diesem Aspekt lobt Jeff Bier die Bemühungen im Bereich High-Level-Programmierung mit schematischen Blockdiagrammen, wie z.B. LabView, bei denen der Anwender keine Zeile C++ sieht, um an sein Ziel zu gelangen.

Variation der 3D-Anwendungen erforderlich

Der einfachste Beweis, dass 3D-Embedded-Vision-Systeme funktionieren, ist die Kinect-Konsole von Microsoft. Für knapp 200 Euro bekommt man in jedem Elektronikhandel einen 3D-Sensor, der zwar nicht für ein industrielles Umfeld entwickelt wurde, aber für zuhause ausreicht. Mikael Bodin weiß auch, dass 3D-Vision immer stärker in die Industrie vordringen wird. Voraussetzung hierfür ist, dass die Systeme einfach zu bedienen seien und dass Embedded-Systeme hierbei eine entscheidende Rolle spielen werden. Man muss sich aber bewusst sein, dass unterschiedliche Märkte unterschiedliche Anforderungen stellen. So erklärt Jeff Bier, dass er sehr oft gefragt werde, wie viel Leistung ein Vision-System haben muss. Die Antwort hängt alleine von der Anwendung ab. Man solle überlegen, ob es nicht auch nicht-industrielle Anwendungen gebe, die mit einfachen und deutlich billigeren Lösungen zu adressieren seien, und welche Marktpotentiale hier verborgen sind.

Was ist aber notwendig, damit Embedded-Vision-Systeme noch erfolgreicher am Markt agieren? Kamalina Srikant ist überzeugt, dass Software Tools wie graphische Programmierumgebungen es dem Anwender zukünftig noch einfacher machen, Embedded-Vision-Systeme einzusetzen. Carsten Strampe fehlt noch ein klares Bekenntnis der Anwender, was deren Anforderungen an Embedded-Vision-Systeme seien. Für Mikael Bodin sind die einfache Bedienbarkeit und die Möglichkeit, Advanced-Vision-Funktionen in die Sensoren zu integrieren, der Schlüssel zum Erfolg. Auch Jeff Bier betont, dass der Erfolg dieser Systeme ganz entscheidend von der Bedienbarkeit, aber auch den Kosten abhängen wird.